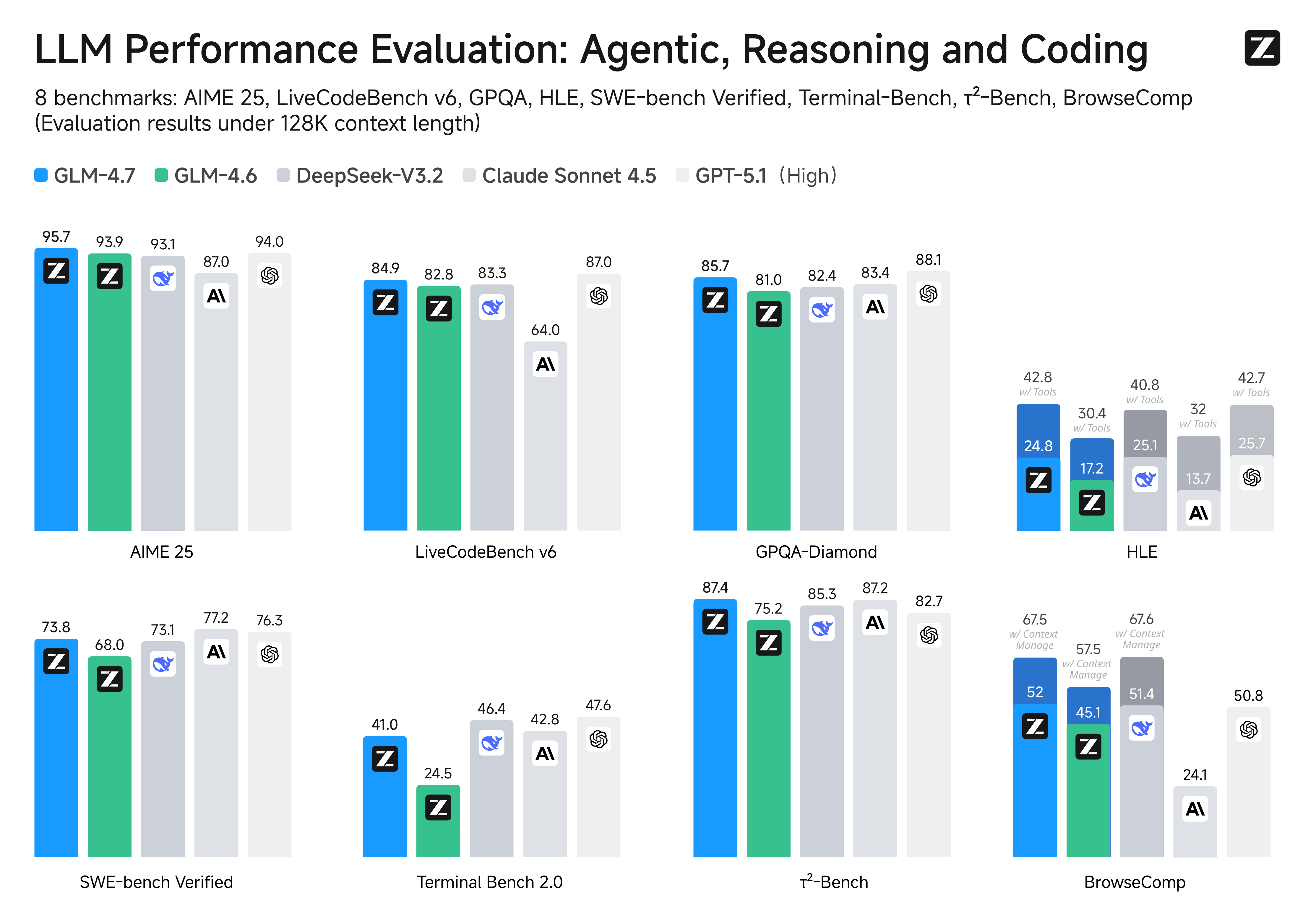

Z.ai представили GLM-4.7 — новую версию своей модели для кодинга, и апдейт получился не косметическим. Основной фокус — агентные сценарии, терминал и устойчивость на длинных задачах. По бенчмаркам рост выглядит вполне предметно: SWE-bench Verified — 73.8% (+5.8%), SWE-bench Multilingual — 66.7% (+12.9%), Terminal Bench 2.0 — 41% (+16.5%). Ключевое отличие GLM-4.7 — работа с мышлением. Модель использует interleaved thinking (думает перед каждым действием), а в агентных сценариях сохраняет reasoning между ходами. За счёт этого длинные цепочки команд в терминале и IDE становятся заметно стабильнее: меньше дрейфа контекста и меньше «переизобретений» одного и того же шага. Отдельно прокачали tool using. На τ²-bench и браузерных задачах модель показывает резкий прирост — и это хорошо коррелирует с реальной практикой: меньше лишних вызовов, больше осмысленных действий. Параллельно выросли математика и сложный reasoning — на HLE с инструментами GLM-4.7 поднимается до 42.8%, что почти на 12 пунктов выше прошлой версии. Есть и неожиданный плюс — UI и “vibe coding”. Модель генерирует более аккуратные веб-страницы, с адекватной версткой, размерами и визуальной иерархией. Для быстрых прототипов и внутренних тулов это может сэкономить немало времени. Важно, что GLM-4.7 уже встроена в популярные агентные среды (Claude Code, Roo Code, Cline и др.), доступна через API Z.ai и OpenRouter, а веса выложены публично — модель можно развернуть локально через vLLM или SGLang. По цене её позиционируют как «Claude-уровень за долю стоимости», что делает её особенно интересной для постоянных агентных нагрузок.

Кажется, мы начинаем привыкать к гонке нейросетей. Новые релизы выходят чуть ли не еженедельно, и часто это просто игра цифрами - "быстрее, выше, сильнее" на полпроцента. Разницу замечают только энтузиасты, сидящие в бенчмарках. Но свежий релиз от Z.ai - модель GLM-4.7 - это история другого порядка. Здесь разработчики не просто накинули мощности, а попытались вылечить главную головную боль всех, кто пишет код с AI: проблему "короткой памяти" и хаотичных действий.

Давайте разберемся, что именно изменилось и почему это может сэкономить вам часы отладки.

Проблема, которую все игнорировали

Если вы пробовали писать сложный код с помощью топовых нейросетей, то знаете этот сценарий. Сначала все идет отлично: модель пишет функцию, предлагает структуру. Но стоит задаче растянуться на десять шагов или потребовать работы с терминалом, как начинается хаос. AI забывает, что делал три шага назад, начинает предлагать те же самые ошибочные решения или теряет нить разговора.

GLM-4.7 пытается лечить именно это. Главное нововведение - так называемое interleaved thinking. Проще говоря, модель "думает" перед каждым действием. Это звучит банально, но на практике дает огромную разницу. Раньше модели часто спешили выдать код, не проверив логику. Теперь же, особенно в агентных сценариях (когда AI сам выполняет цепочку задач), сохраняется ход рассуждений между шагами.

Результат? Длинные цепочки команд в терминале или IDE перестали рассыпаться. Модель помнит, зачем она открыла этот файл пять минут назад, и не пытается "переизобрести велосипед", если что-то пошло не так.

Что говорят сухие цифры

Чтобы не быть голословными, посмотрим на тесты. Рост производительности здесь не косметический:

- SWE-bench Verified: 73.8% (рост на 5.8%). Это тест на решение реальных задач по программной инженерии.

- Terminal Bench 2.0: 41% (рост на 16.5%). Это про умение работать с командной строкой, где одна ошибка может сломать все окружение.

- Математика и сложная логика: на тестах с использованием инструментов модель прыгнула сразу на 12 пунктов вверх.

Это значит, что "галлюцинаций" при работе со сложными алгоритмами станет меньше, а шанс, что модель правильно настроит вам рабочее окружение с первого раза - выше.

"Vibe coding" и верстка, на которую можно смотреть

Интересный побочный эффект обновления, который разработчики назвали "vibe coding". Обычно, когда просишь нейросеть набросать простой веб-интерфейс, получается что-то кривое, в стиле сайтов из 90-х. GLM-4.7 научилась чувствовать визуальную иерархию.

Она генерирует аккуратные страницы с нормальными отступами, адекватными размерами шрифтов и логичным расположением кнопок. Это не заменит профессионального дизайнера, но для создания быстрых прототипов или внутренних админок - это спасение. Вы получаете рабочий инструмент, от которого не вытекают глаза, сразу, без получаса правок CSS.

Экономия бюджета

Пожалуй, самый приятный момент - это доступность. Рынок сейчас захвачен дорогими моделями вроде Claude или GPT-4. GLM-4.7 позиционируется как "топовый уровень за долю стоимости".

Более того, модель уже встроили в популярные инструменты для разработчиков (Claude Code, Roo Code, Cline). А самое главное - веса модели выложены публично. Это значит, что если у вас есть мощное железо, вы можете развернуть её локально и вообще не платить за токены, сохраняя при этом полную приватность вашего кода.

Перспектива и риски

Конечно, чудес не бывает. Даже с улучшенным "мышлением" модель может ошибаться. Риск здесь в том, что из-за возросшей стабильности мы можем начать доверять ей слишком сложные задачи без должной проверки. Если AI уверенно выполняет 20 шагов в терминале, легко расслабиться и пропустить момент, когда на 21-м шаге он случайно удалит важную папку. Контроль со стороны человека все еще обязателен.

Но тренд очевиден: мы переходим от чат-ботов, которые просто выплевывают куски кода, к автономным помощникам, способным вести проект и удерживать в "голове" сложную архитектуру.

Итог

GLM-4.7 - это не революция, но очень крепкая эволюция в правильном направлении. Она делает ставку на надежность в длинных дистанциях и понимание контекста, а не просто на генерацию красивого текста.

А вы готовы доверить AI доступ к вашему терминалу для самостоятельной работы, или пока предпочитаете копировать код вручную, чтобы держать руку на пульсе?

- #нейросеть для программирования

- #GLM-4.7

- #AI для разработки

- #генерация кода

- #автономный AI помощник

- #генерация веб-интерфейса

- #AI верстка

- #SWE-bench

- #Terminal Bench

- #interleaved thinking

- #агентные

- #interleaved

- #terminal bench 2.0

Читайте также

Больше никакого ручного поиска: ИИ в Яндекс Картах теперь сам читает меню и прайс-листы

Приложение "Яндекс Карты" получило масштабное обновление на базе нейросетей YandexGPT. Теперь встроенный искусственный интеллект умеет искать заведения не просто по названию или общей категории, а по конкретным позициям в меню или детальному списку услуг. Разбираемся, как алгоритмы анализируют прайс-листы салонов красоты и ресторанов, чем это полезно для пользователей и как новый умный поиск экономит время.

Больше не нужно платить: Google бесплатно раздает «Персональный интеллект» всем пользователям

Компания Google сделала неожиданный шаг, открыв бесплатный доступ к функции «Персональный интеллект» для всех пользователей браузера Chrome, чат-бота Gemini и смартфонов с поддержкой AI Mode. Разбираемся, как алгоритмы изучают ваши привычки для автоматизации рутины, почему корпорация отказалась от платной подписки на эту фишку и насколько безопасно доверять встроенной нейросети свои личные данные.

Siri получает свой дом на экране iPhone: почему в iOS 27 появится полноценный чат с ИИ

По данным авторитетного инсайдера Марка Гурмана из Bloomberg, в новой операционной системе iOS 27 компания Apple кардинально изменит концепцию своего голосового помощника. Siri перестанет быть просто всплывающим окном и превратится в полноценное отдельное приложение с текстовым чатом, историей запросов и расширенными ИИ-функциями. Разбираемся, зачем Apple понадобился собственный аналог ChatGPT, как будет выглядеть новый интерфейс и почему старый формат голосового ассистента изжил себя.